Künstliche Intelligenz und maschinelles Lernen in bewaffneten Konflikten

In einer Zeit zunehmender Konflikte und rascher technologischer Veränderungen muss das Internationale Komitee vom Roten Kreuz (IKRK) sowohl verstehen, welche Auswirkungen diese neuen Technologien auf die von bewaffneten Konflikten betroffenen Menschen haben, als auch humanitäre Lösungen entwickeln, die den Bedürfnissen derjenigen gerecht werden, die den Risiken dieser Technologien am stärksten ausgesetzt sind.

Das IKRK hat wie viele Organisationen aus verschiedenen Sektoren und Regionen mit den Auswirkungen, die künstliche Intelligenz (KI) und maschinelles Lernen auf seine Arbeit haben, zu kämpfen. KI bedeutet den Einsatz von Computersystemen zur Ausführung von Aufgaben, die Erkenntnisse, Planung, Argumentation oder Lernen erfordern – Aufgaben, die meist mit menschlicher Intelligenz verbunden sind. Systeme für maschinelles Lernen sind KI-Systeme, die mit Daten „trainiert“ werden und von ihnen „lernen“. Diese Daten bestimmen letztlich die Funktionsweise der Systeme. Da es sich um Software-Tools oder Algorithmen handelt, die für viele verschiedene Aufgaben eingesetzt werden können, sind die potenziellen Auswirkungen gegebenenfalls weitreichend und es fehlt bisher an einem umfassenden Verständnis dafür.

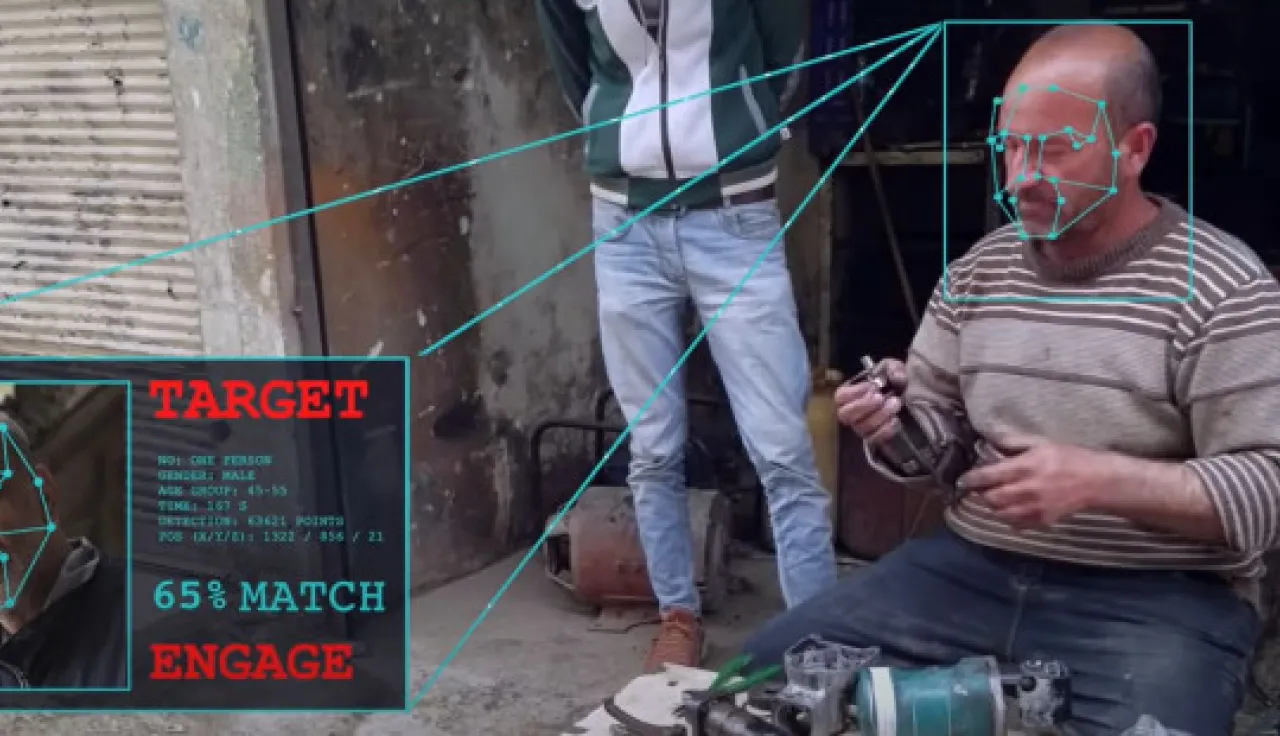

Es gibt zwei weitreichende – und unterschiedliche – Anwendungsbereiche von KI und maschinellem Lernen, an denen das IKRK ein besonderes Interesse hat: Erstens die Verwendung in der Kriegsführung oder in anderen Situationen von Gewalt; und zweitens die Verwendung bei humanitären Einsätzen zur Unterstützung und zum Schutz von Betroffenen bewaffneter Konflikte.