Preguntas y respuestas: Lo que hay que saber sobre las armas autónomas

Las armas autónomas no forman parte de una obra de ciencia ficción que transcurre en un lejano futuro distópico. Son una causa inmediata de preocupación humanitaria y exigen una respuesta política urgente por parte de la comunidad internacional. Neil Davison, asesor superior científico y en políticas del CICR, lo explica a continuación.

¿Qué es un arma autónoma?

Según el CICR, los sistemas de armas autónomas son todas las armas que seleccionan objetivos y les aplican la fuerza sin intervención humana.

Cuando alguien activa un arma autónoma, no sabe exactamente a qué personas u objetos atacará, ni tampoco sabe con precisión dónde ni cuándo se producirá ese ataque.

Esto se debe a que las armas autónomas se activan mediante sensores y software que comparan aquello que los propios sensores detectan en el entorno con un "perfil de objetivo".

Por ejemplo, podrían activarse por la forma de un vehículo militar o el movimiento de una persona. El vehículo o la víctima son los desencadenantes del ataque, no el usuario.

Nuestra preocupación en torno a este proceso radica en la falta de criterio humano con relación al uso de la fuerza. Ese fenómeno dificulta el control sobre los efectos de estas armas.

Una vez que el usuario activa el arma, ¿cómo sabe si la forma que desencadenará el ataque será un vehículo militar, y no un coche civil?

Aun si atacara un vehículo militar, ¿qué sucede con la población civil que pueda estar en las inmediaciones en ese momento?

¿Cuándo se fabricarán estas armas?

Las minas pueden considerarse armas autónomas rudimentarias. Los graves daños que causaron a la población civil durante muchos conflictos armados —dado que sus efectos son difíciles de controlar— están ampliamente documentados, motivo por el cual, en 1997, la comunidad internacional decidió prohibir las minas antipersonal.

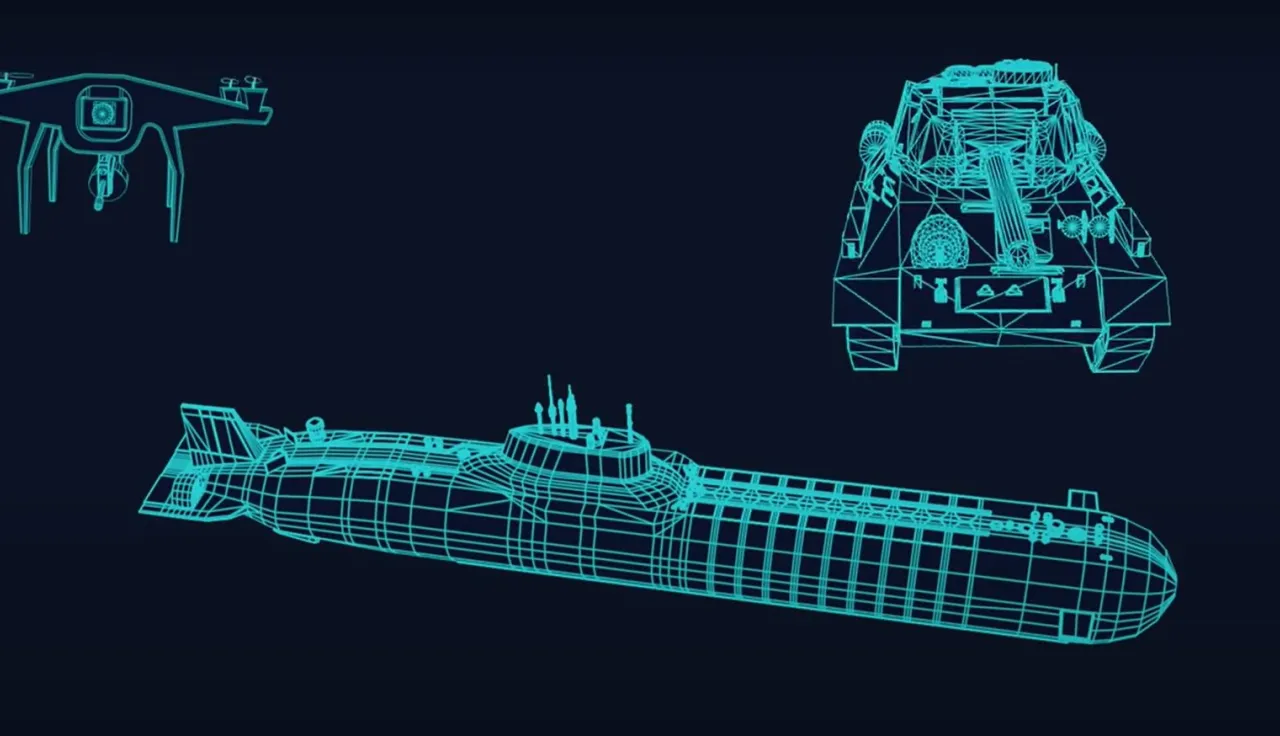

También se diseñaron otras clases de armas autónomas, aunque únicamente suelen utilizarse en circunstancias muy limitadas. Por ejemplo, los sistemas de defensa aérea que atacan misiles entrantes y municiones de tipo "loitering", o bien los llamados "drones kamikaze", diseñados para destruir radares militares, tanques o vehículos blindados.

Hasta la fecha, esas armas autónomas en general se utilizaron contra objetivos militares claros (p . ej., armas y municiones, radares militares y tanques enemigos) en zonas con escasa población civil u objetos civiles.

Además, suelen estar bajo estricta supervisión humana, con la posibilidad de ser desconectadas en caso de que la situación cambie o suceda algo inesperado.

BSin embargo, las tecnologías y prácticas en materia de armamento están cambiando rápidamente. Tanto los ejércitos como los desarrolladores de armas tienen interés en integrar el uso autónomo de la fuerza en una mayor variedad de armas, plataformas y municiones, incluidos los drones armados, que, en la actualidad, son controlados por operadores humanos. Es preocupante que exista interés en el uso de armas autónomas para atacar directamente a seres humanos.

¿A qué obedece la preocupación del CICR por las armas autónomas?

En pocas palabras, conllevan riesgos humanitarios, desafíos jurídicos e interrogantes éticos dadas las dificultades para anticipar y limitar sus efectos.

Como ya se dijo, aumentan los peligros que enfrenta la población civil, y los combatientes que ya no participan en los enfrentamientos —es decir, los que se rindieron o están heridos— también enfrentan mayores riesgos.

Además, las armas autónomas también pueden acelerar el uso de la fuerza más allá del control humano. Si bien la velocidad puede ser una ventaja para los ejércitos en determinadas circunstancias, cuando esta no se controla, existe el riesgo de que los conflictos se intensifiquen de manera imprevisible y se agraven las necesidades humanitarias.

Desafíos jurídicos

El derecho internacional humanitario exige a los combatientes que ejecuten ataques específicos partiendo de criterios jurídicos de evaluación según el contexto.

Sin embargo, el funcionamiento de las armas autónomas —por el cual el usuario no elige ni el objetivo específico ni el momento o el lugar precisos de un ataque— dificulta esa tarea. ¿En qué condiciones podrían los usuarios de armas autónomas tener una certeza razonable de que esas armas únicamente atacarán objetos que, en efecto, son objetivos lícitos en ese momento y que no provocarán daños desproporcionados a la población civil?

Las armas autónomas también encierran complejidades en lo referido a la responsabilidad jurídica. Cuando se cometen violaciones del derecho internacional humanitario, es fundamental responsabilizar a los autores para hacer justicia por las víctimas y disuadir de futuras violaciones. Por lo general, las investigaciones se centran en la persona que disparó el arma y en el jefe militar que dio la orden de ataque.

Cuando se utilicen armas autónomas, ¿quién explicará, por ejemplo, por qué un arma autónoma atacó un autobús civil?

Existen muchas preguntas acerca de si los presuntos autores de crímenes de guerra podrían considerarse responsables en el marco de los regímenes jurídicos existentes.

Interrogantes éticos

En esencia, existe una preocupación generalizada y grave por la cesión de decisiones en torno a la vida y la muerte en favor de sensores y software.

Los seres humanos tienen una capacidad moral, que guía sus decisiones y acciones, aun en el contexto de conflictos armados, en los que la decisión de matar está en cierta medida normalizada.

Las armas autónomas reducen —e, incluso, pueden eliminar— la capacidad humana de decidir si matar, herir o destruir. Conllevan un proceso de deshumanización que socava nuestros valores y nuestra humanidad compartida.

ATodas las armas autónomas que ponen en peligro a los seres humanos plantean estos interrogantes éticos, pero revisten especial gravedad en el caso de las armas diseñadas o utilizadas para atacar directamente a los seres humanos.

¿Qué papel cumplen la inteligencia artificial y el aprendizaje automático en el contexto de las armas autónomas?

Existe un interés creciente por el uso de inteligencia artificial (IA), en especial del aprendizaje automático, para controlar las armas autónomas.

El software de aprendizaje automático se "entrena" con datos a fin de crear un modelo propio para realizar una tarea específica y las estrategias necesarias para ejecutarla. De cierta manera, el software se escribe a sí mismo.

A menudo, este modelo se considera una "caja negra", dado que, para los humanos, es extremadamente difícil predecir, entender, explicar y probar cómo, y a partir de qué criterio, un sistema de aprendizaje automático llegará a una evaluación o a un resultado concretos.

Como es de público conocimiento en lo que respecta a diversas aplicaciones (p. ej., en el ámbito policial), los sistemas de aprendizaje automático también plantean interrogantes en materia de sesgo codificado, incluso por motivo de raza, género y sexo.

Al utilizar armas autónomas, sin excepción, puede resultar muy difícil para los usuarios predecir sus efectos. Como se mencionó antes, es posible que el usuario incluso no sepa qué desencadenará un ataque. Las armas autónomas controladas por aprendizaje automático acentúan ese interrogante. Plantean la posibilidad de la imprevisibilidad por diseño.

Algunos sistemas de aprendizaje automático continúan "aprendiendo" mientras se los utiliza —es un tipo de aprendizaje denominado "activo", "en línea" o "autoaprendizaje"—, lo que significa que su modelo de tarea cambia con el tiempo.

Aplicado a las armas autónomas, si se permitiera que el sistema "aprendiera" a identificar objetivos mientras se lo utiliza, ¿cómo podrían los usuarios de armas autónomas tener una certeza razonable de que el ataque se mantendrá dentro de los límites de lo jurídicamente permitido en conflictos bélicos?

¿Qué respuesta recomienda el CICR a los gobiernos y a terceros?

TEl CICR recomienda que los Estados adopten nuevas normas jurídicamente vinculantes con respecto a las armas autónomas. Las nuevas normas favorecerán tanto la prevención de graves riesgos de daño a la población civil como el abordaje de interrogantes éticos y, a la vez, ofrecerán el beneficio de la seguridad jurídica y la estabilidad.

En primer lugar, deberían prohibirse las armas autónomas imprevisibles. Es decir, aquellas armas autónomas diseñadas o utilizadas de modo tal que sus efectos no puedan comprenderse, preverse ni explicarse suficientemente, incluidas las que "aprenden" los objetivos durante su utilización y, quizás, las armas autónomas controladas por aprendizaje automático en general.

En segundo lugar, deben prohibirse las armas autónomas diseñadas y utilizadas para aplicar la fuerza directamente contra las personas.

En tercer lugar, deben existir restricciones drásticas respecto del diseño y del uso de todas las otras armas autónomas para mitigar los riesgos ya mencionados, asegurar el cumplimiento de la ley y abordar los interrogantes éticos.

Como guardián del derecho internacional humanitario, el CICR desalienta que se elaboren nuevas normas a la ligera.

Nos comprometemos a promover el desarrollo progresivo del derecho para que las normas existentes no se vean socavadas. Queremos asegurarnos de que las protecciones para las personas damnificadas por los conflictos armados se mantengan y, cuando sea necesario, se refuercen dada la evolución de las armas y de los métodos de guerra.

Al igual que con las minas antipersonal, las armas láser cegadoras y las municiones en racimo, necesitamos un nuevo tratado jurídicamente vinculante para proteger a la población civil y a los combatientes. Debe preservarse la humanidad durante la guerra.

Estas normas podrían establecerse en un nuevo Protocolo de la Convención sobre Ciertas Armas Convencionales (CCAC) o en otro instrumento jurídicamente vinculante.

¿Qué tan optimista es el CICR respecto de la adopción de nuevas normas?

Confiamos en que los Estados acordarán nuevas normas internacionales sobre armas autónomas. La mayoría de los Estados reconocen la necesidad de asegurar una medida de control y juicio humano en el uso de la fuerza, lo que implicará el establecimiento de restricciones drásticas a las armas autónomas.

Un número creciente de Estados está dispuesto a adoptar prohibiciones y restricciones específicas. Otros reconocen la necesidad de establecer esos límites, aunque aún no se comprometieron a adoptar nuevas normas.

Actualmente, algunos de los Estados que antes se oponían a nuevas normas muestran un mayor grado de apertura, tal vez impulsados por la profundización de los debates multilaterales y por la evolución de los conflictos recientes. Hoy se debaten soluciones creíbles y pragmáticaspara regular las armas autónomas. Dados los desarrollos y las prácticas actuales en lo referido a tecnología militar, su adopción es urgente.

Ahora se necesita un liderazgo político basado en principios por parte de los Estados para convertir esa solución en un instrumento jurídicamente vinculante que proteja a las personas durante mucho tiempo.

Video

Más información:

Posición del CICR sobre los sistemas de armas autónomos

Declaraciones recientes:

Marzo de 2022

Diciembre de 2021

Mayo de 2021