Intelligence artificielle et apprentissage automatique dans les conflits armés

À l’heure où les conflits s’intensifient et les changements technologiques s’accélèrent, le Comité international de la Croix-Rouge (CICR) doit à la fois comprendre l’impact des nouvelles technologies sur les victimes des conflits armés, et proposer des solutions humanitaires qui répondent aux besoins des personnes les plus vulnérables aux risques que représentent ces technologies.

Comme beaucoup d’autres organisations dans différents secteurs et régions, le CICR est confronté aux conséquences de l’intelligence artificielle (IA) et de l’apprentissage automatique sur ses activités. L’IA consiste en l’utilisation de systèmes informatiques pour mener à bien des tâches exigeant des capacités de cognition, de planification, de raisonnement ou d’apprentissage – tâches souvent associées à l’intelligence humaine. Les systèmes d’apprentissage automatique sont des systèmes d’IA qui sont « entraînés » avec des données et « apprennent » à partir de données. Ce sont ces données qui définissent la manière dont les systèmes fonctionnent. Comme il s’agit de logiciels ou d’algorithmes qui peuvent être appliqués à de nombreuses tâches différentes, les implications potentielles sont considérables et pas encore entièrement connues.

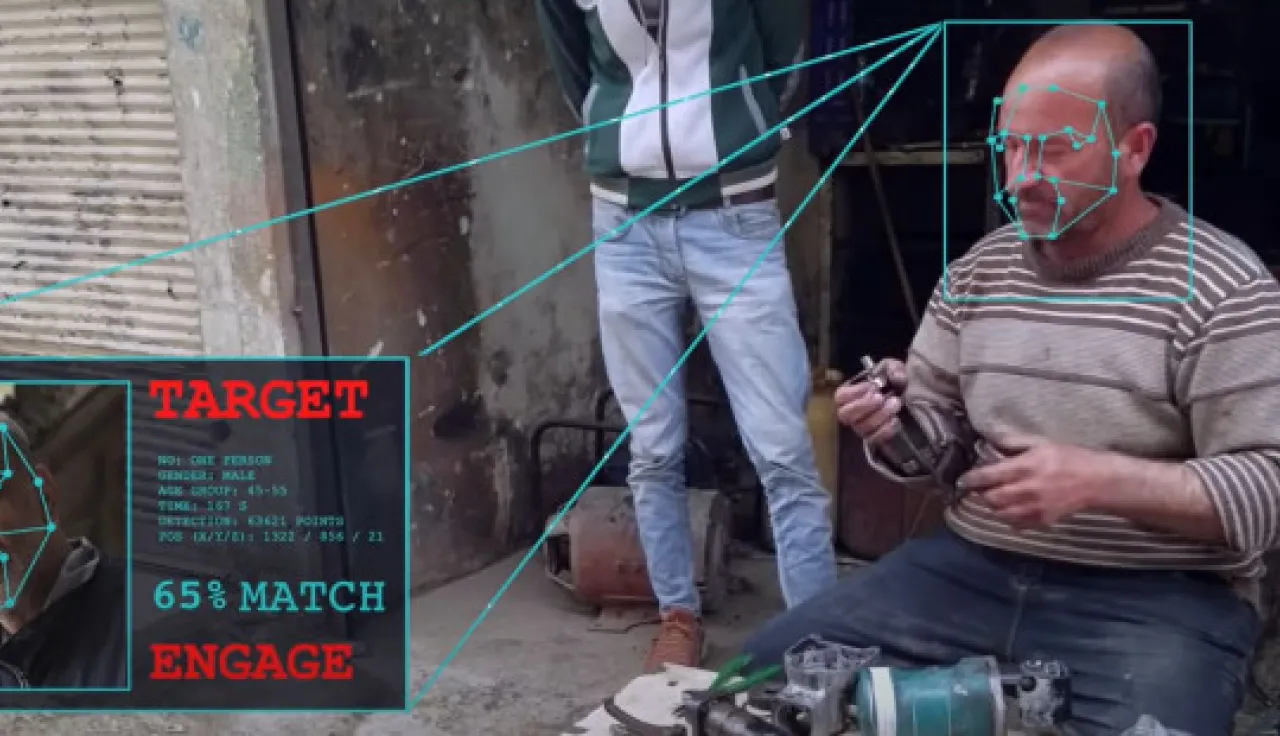

Le CICR s’intéresse tout particulièrement à deux domaines d’application de l’IA et de l’apprentissage automatique, vastes et bien distincts : d’une part, leur utilisation dans les conflits armés et les autres situations de violence ; d’autre part, leur utilisation dans l’action humanitaire afin d’assister et de protéger les victimes de conflits armés.